/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2024%2F10%2FCybercab01.jpg)

Teslas miljardfälla: Därför kan Elon Musks kameradröm bli dyrare än radar och Lidar

/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2026%2F03%2Fferdrik_webb.jpg)

Fredrik Sandberg

9 jan 2026

Fyra familjemedlemmar dog i en krasch och Tesla stäms av en överlevande familjemedlem. Anledningen är Elon Musks kommunicerade övertro på sitt eget självkörande system, som återigen har skjutits på framtiden. Mer och mer pekar på att företaget kan ha kört in i en återvändsgränd och att beslutet att bara använda kameror kan bli dyrare än […]

Fyra familjemedlemmar dog i en krasch och Tesla stäms av en överlevande familjemedlem. Anledningen är Elon Musks kommunicerade övertro på sitt eget självkörande system, som återigen har skjutits på framtiden. Mer och mer pekar på att företaget kan ha kört in i en återvändsgränd och att beslutet att bara använda kameror kan bli dyrare än system med Lidar och radar.

Tesla står inför en av flera rättsliga prövningar efter en olycka i Idaho där fyra familjemedlemmar och en hund omkom. Överlevaren Nathan Blaine stämmer nu biltillverkaren och hävdar att bolagets marknadsföring invaggat dem i en livsfarlig ”falsk känsla av säkerhet”.

Olyckan inträffade i september 2023 när familjen Blaines Tesla plötsligt skar över mittlinjen och frontalkrockade med en lastbil. Enligt Nathan Blaines stämningsansökan, som rapporteras av bland annat The Independent och NBC, miste hans fru, två döttrar, en svärson och familjens hund livet. Blaine anklagar Tesla och Elon Musk för att ha ”avsiktligt förvanskat säkerhetsnivån” hos bilens förarstödssystem för att gynna bolagets aktiekurs.

Stämningen kommer i ett läge där USA:s rättsväsende har blivit alltmer kritiskt mot Teslas beskrivning av Autopilot och Full Self-Driving (FSD). I augusti 2025 föll en dom i Miami där en jury fann Tesla medansvariga för en dödlig krasch och dömde bolaget till ett skadestånd på 243 miljoner dollar (ca 2,6 miljarder kronor). Enligt Reuters och Investing.com slog juryn fast att Teslas marknadsföring skapat förväntningar som tekniken inte kan möta.

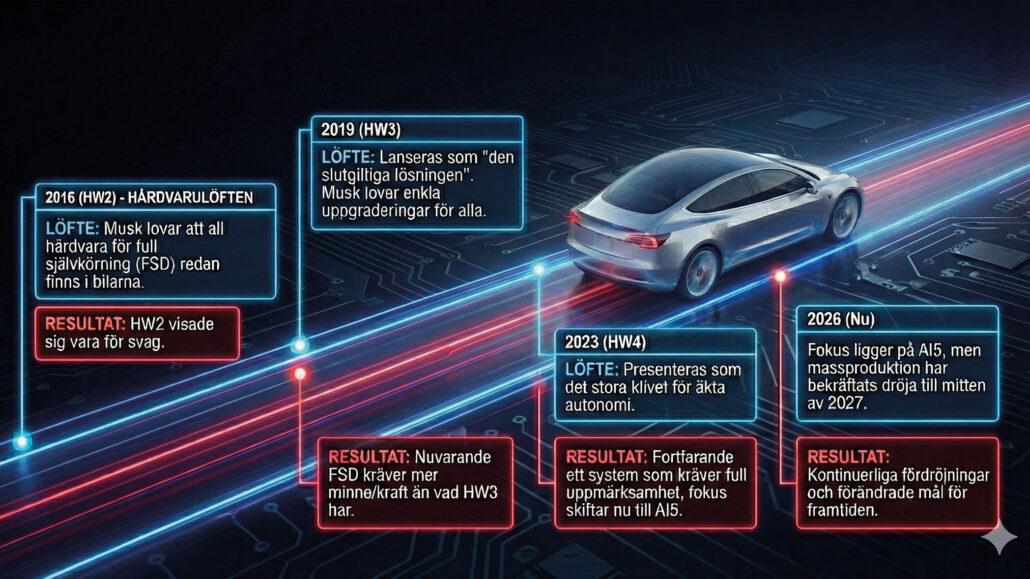

Sedan 2016 har Elon Musk lovat att total självkörning ligger runt hörnet, nästa år kommer det. Han har också upprepade gånger sagt att systemet är säkrare än vad en mänsklig förare är. Trots att Tesla officiellt endast befinner sig på Nivå 2, envisas Elon Musk med att marknadsföra systemet som mer kompetent än det är. Han har till och med nyligen hävdat att man kan skriva sms på sin telefon när man har autopiloten inkopplad. I USA kan Teslas bilar med rätt hårdvara köra själv, men under uppsikt, det är därför Tesla kallar det Nivå 2 (av fem nivåer av självkörning, där nivå 5 är helt självkörande i alla miljöer, Waymo befinner sig på Nivå 4 och tillåter förarlösa resor). Men att kalla systemet för Autopilot och FSD när det inte kan klassas som vare sig det ena eller det andra har blivit dyrt för Tesla och har enligt en domstol i Miami också orsakat dödsfall.

I domen i Miami slogs det för första gången juridiskt fast att Teslas hård- och mjukvara led av specifika konstruktionsfel som bidrog till dödsolyckan. Enligt rättshandlingar och expertvittnen som citeras av Reuters och The Verge, fokuserade juryn på tre tekniska huvudområden: 1. Begränsningar i ”Vision-only”-systemet, det vill säga Teslas beslut att förlita sig enbart på kameror och plocka bort radar- och ultraljudssensorer. Expertvittnen i rättegången kunde visa att systemet led av svårigheter att identifiera stationära objekt i hög hastighet vid specifika ljusförhållanden. Juryn fann att bilens mjukvara i det aktuella fallet misslyckades med att skilja en vit lastbilssida från en ljus himmel, en teknisk begränsning som enligt experter hade kunnat avhjälpas med Lidar eller fungerande radar, rapporterar Bloomberg.

Den andra punkten handlade om saknad geofencing: Juryn slog fast att Tesla brustit genom att tillåta Autopilot på vägar den inte är designad för. Trots kännedom om att systemet användes utanför säkra motorvägsmiljöer, vilket det enligt Teslas egna instruktionsmanualer inte ska göra, saknades tekniska spärrar för att förhindra det. Tredje punkten: Ineffektiv förarövervakning: Istället för aktiv ögonspårning förlitade sig Tesla på tryck på ratten. Enligt NTSB skapade detta en farlig ”automation bias” – en falsk trygghet där föraren invaggas i tron att systemet har full kontroll och slutar övervaka vägen.

I studien ”Between Vision and Reality: The Gap Between Tesla’s Full Self-Driving (FSD) Promises and Present Capabilities” från 2024 riktas kritik mot Teslas beslut att förlita sig enbart på kameror, så kallad ”vision-only”-teknik för att nå helt självkörande bilar. Enligt författaren Djalal Khanchali är det stora problemet med Teslas självkörande teknik situationer där sikten är begränsad, som vid kraftigt regn, dimma eller bländande motljus.

Konkurrenter som Waymo, Cruise och kinesiska Baidu använder en kombination av Lidar, radar och kameror – så kallad sensorfusion – för att skapa flera lager av säkerhet. Enligt studien innebär detta att Teslas system har svårare att hantera oväntade situationer, så kallade ”edge cases”, vilket inkluderar obevakade vänstersvängar, komplexa vägarbeten och plötsliga rörelser från fotgängare.

Studien lyfter även fram de etiska utmaningarna med Teslas affärsmodell. Genom att låta vanliga konsumenter fungera som betatestare för ofärdig mjukvara på allmänna vägar, leder till ökad granskning från myndigheter, istället för samarbete (sen kan man ju fråga hur moraliskt det är att ta betalt för att någon ska riskera livet för ens teknikutveckling).

Enligt Khanchali är alltså utvecklingen inom autonomi en ”långsiktig process” som sker genom mödosamma, stegvisa förbättringar snarare än plötsliga genombrott. Teslas framtid hänger på företagets förmåga att skifta från en ”narrativdriven disruption” till ”operativ disciplin och rigorös validering”. Med Elon Musk vid rodret är det nog att betrakta som en utopi. Enligt studien framstår Teslas tekniska utveckling mer och mer ha blivit en förlängning av Elon Musks övertygelse. Hans dominerande roll har skapat en miljö där ideologiska visioner ofta tillåts trumfa ingenjörsmässig realism.

Denna kultur av ”visionär press” har även lett till en cykel av ständiga löften som inte infriats. Genom att år efter år lova att full självkörning är ”runt hörnet” har Elon Musk skapat en miljö där fokus skiftat från systematisk validering av säkerhet till att producera imponerande demonstrationsvideor. Redan 2019 lovade han att man inom ett halvår kunde gå och lägga sig i bilen och sova, bilen skulle köra själv. Vilket fick aktiekursen att rusa. Någon sömn i bilen blev inte av. Några år senare gjorde Elon Musk valet att kasta ut radar ur systemet, vilket mötte intern kritik på Tesla. De som kritiserade beslutet fick sparken.

När kritiska röster och experter försvinner hamnar organisationen i en ”ekokammare” där intern kritik tystas och där man blir blind för problem, som de komplexa extremfall i trafiken som inte låter sig lösas med enbart mer beräkningskraft.

Till skillnad från konkurrenter som Waymo eller Mercedes, som valt en mer transparent och samarbetsvillig väg gentemot myndigheter, har Tesla under Musks ledning ofta intagit en konfrontativ hållning. Bristen på öppenhet kring testdata och systembegränsningar ses av Khanchali som en direkt följd av en företagskultur som prioriterar snabba utrullningar av ny mjukvara framför transparens. Att rulla ut ny mjukvara med spel och streamingtjänster är underhållande, men att göra samma sak med livskritiska system är problematiskt. Det nöter ner allmänhetens och framför allt tillsynsmyndigheternas förtroende för förarlösa fordon. Konkurrenterna rullar ut system långsamt i takt med myndigheternas krav och tillsyn, Tesla kallar systemet för totalt självkörande utan att det är det, vilket istället för att bli godkänt av myndigheter leder till stämningar och förbud, som nu senast när Kalifornien begränsar Tesla att använda namnet Autopilot i sin marknadsföring.

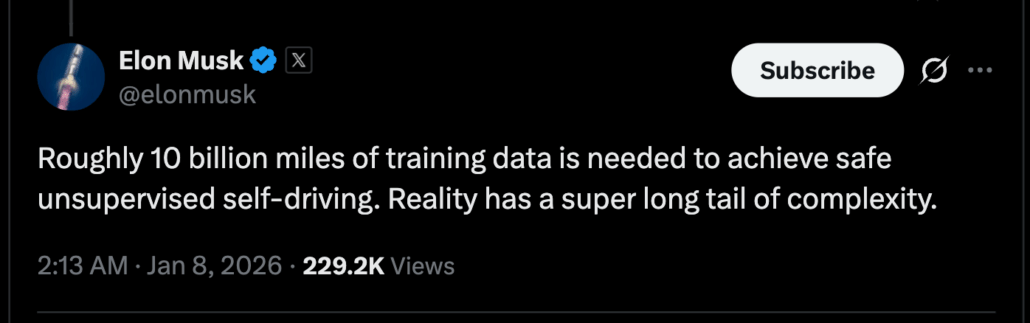

Men det stora problemet för Tesla kan ha blivit just valet att kasta ut all annan teknik än kameror. Problemet är som sagt att bilens kameror har svårt att uppfatta omgivningen vid dimma, snö, regn och motljus. Det ska Tesla lösa på sedvanligt vis, med nästa generations datorer. Just nu är det den som tidigare kallades HW5, men som Elon Musk döpt om till AI5, som ska ordna upp allt (tidigare var det i turordning HW2, HW3 och HW4 som skulle lösa problemen). AI5 ska vara tio gånger snabbare än nuvarande generation 4. Dess snabbhet ska kunna läsa av pixlar med en hastighet som gör att ovan nämnda hinder inte längre är hinder. Men som vanligt, blir det försenat. Några bilar som lämnat fabrik har fått hårdvaran, men volymproduktionen kommer att dröja till mitten av 2027 (ytterligare 18 månaders väntan för de som köpt FSD). Idag gick dessutom Elon Musk ut med att de måste få fler registrerade miles av data, 10 miljarder för att det ska bli möjligt med helt självkörande bilar. Än en gång dras tidslinjen ut. Ändå sa Musk så sent som i slutet av 2025 att oövervakade robotaxis skulle rulla i Texas inom kort – då hade bolaget bara samlat in 7 miljarder miles. Med nuvarande utvecklingstakt beräknas det nya datamålet nås först i juli 2026, vilket innebär att verklig autonomi, inklusive nödvändig validering och myndighetsprocesser, sannolikt ligger minst ett år bort i tiden.

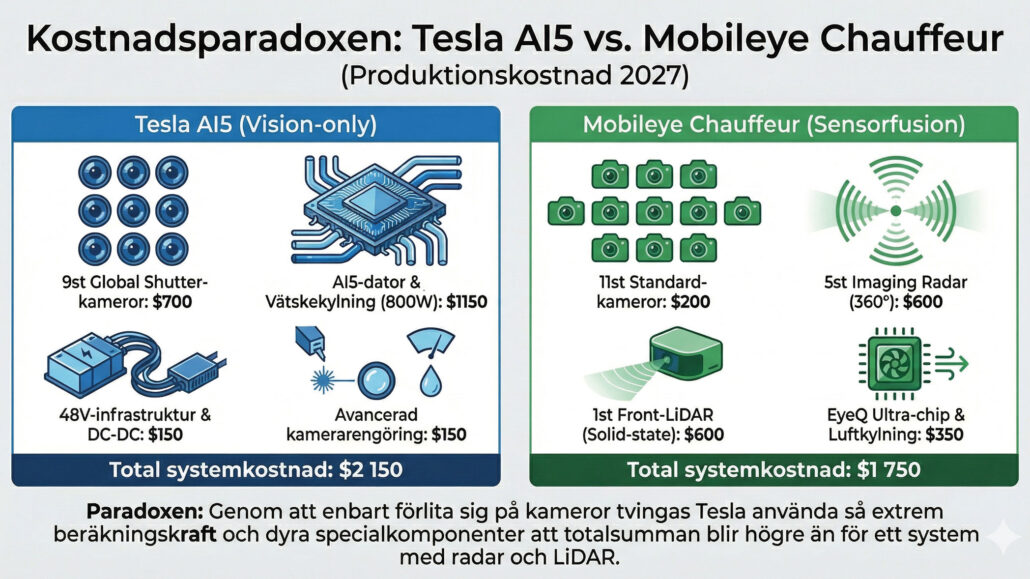

Frågan är bara om målet nås om ett år. Kommer det nya chipet, AI5, som enligt Tesla ska erbjuda en beräkningskapacitet på över 2 000 TOPS – en kraftfull men energislukande lösning som kräver en total ombyggnad av bilens elsystem – att räcka? Inte chans, anser många analytiker. Anledningen är att kameror aldrig kommer att räcka till för att nå självkörning på nivå 5, där man kan sova i bilen. Hur snabb datorn än är kommer den inte att kunna processa information som inte finns, exempelvis när kamerorna blir bländade. Lidar och radar-system kan däremot ”se” i dessa situationer. För att lösa problemet med motljus som bländar kamerorna har Tesla också ansökt om patent för nya kameralinser. Som nog när de väl produceras också måste implementeras.

Frågan är med andra ord om Tesla har valt rätt väg, att endast förlita sig på kameror. Anledningen till att beslutet togs att kasta ut radar och att inte använda Lidar är att Lidar är dyrt och när man började bygga systemen krockade radarn med kamerorna. I systemets barndom brottades Tesla med klassisk programmering, där man använde fasta regler (”om/så-logik”) för att försöka få bilens kameror och radar att samarbeta. Detta skapade ofta konflikter. Om kameran tolkade en skugga under en bro som fri väg medan radarn läste av bron som ett solitt metallföremål, uppstod en osäkerhet som programmerarna tvingades lösa manuellt genom att koda regler för vilken sensor som skulle prioriteras.

Sen kom AI. Nu behöver man inte längre handkoda reglerna för hur olika sensorer ska interagera. Istället matas rådata från kameror, Lidar och radar in i en och samma AI-modell som genom miljontals mil av träning själv lär sig att förstå sammanhanget. AI:n kan nu avgöra att radarn i en specifik ljusvinkel är mer tillförlitlig för avståndsbedömning, medan kameran ger den korrekta tolkningen av vad föremålet faktiskt är. Istället för att sensorerna skapar konflikter, förstärker de nu varandra. De fungerar dessutom som backup mot varandra.

Teslas ursprungliga argument för att ta bort radar och Lidar – att det var för tekniskt svårt att få sensorerna att ”prata” med varandra – verkar helt enkelt inte längre vara giltigt. Det gör att de som satsat på sensorer som Lidar och radar har fördelen att dessa kan ge exakta mätvärden även i totalt mörker, hårt regn eller tät dimma. Just mörker är intressant, hur ska Tesla lösa detta med enbart kameror? Genom att räkna fotoner.

Det finns kameror som kan räkna fotoner. De kostar upp till en miljon kronor. När Tesla pratar om fotonräkning för mörkerkörning handlar det om mjukvara. Enkelt förklarat mäter en vanlig digital kamera, med så kallade CMOS-sensorer, mängden ljus som når en pixel under en viss tid. SPAD-sensorer (Single-Photon Avalanche Diode) däremot, mäter varje foton som når pixeln. Fotonen får en elektrisk laddning och kan mätas individuellt i ett hav av brus som CMOS-sensorer fångar upp, vilket gör att fotonräkning ger en skarp bild även när det är mörkt.

SPAD-sensorer är under utveckling och som sagt svindyra. Tesla kommer alltså inte att använda sådana, men det finns en annan teknik. En vanlig kamera har en bildprocessor som komprimerar och bearbetar bilden för mänsklig perception, Teslas självkörande system skippar den biten och matar rå data direkt från kamerasensorn in i bilens neurala nätverk. Genom att arbeta med oprocessad rådata behåller systemet ett högt dynamiskt omfång, vilket gör att AI:n kan utläsa detaljer i nästan totalt mörker eller kraftigt motljus som traditionell bildbehandling annars skulle ha filtrerat bort. De kameror som används i Teslas HW4-bilar idag har Sony IMX963-sensorer på 5 megapixel. Det är mycket ljuskänsliga CMOS-sensorer, men skiljer sig fundamentalt från ”äkta” fotonräknande SPAD-sensorer. Men det verkar inte som att de nuvarande kamerorna räcker till ändå. Kodläckor pekar på att på en ny skräddarsydd sensor kallad IMX00N kommer att användas. Denna teknik förväntas introducera ”Global Shutter”, vilket exponerar alla pixlar samtidigt för att helt eliminera den rörelseoskärpa och förvrängning som uppstår vid hög hastighet, samtidigt som en högre upplösning spås ge systemet betydligt längre sikt. Ny hårdvara alltså, som måste in i de bilar vars ägare har förköpt FSD. Till det ska ytterligare ny mjukvara läggas på. Det handlar alltså inte bara att eftermontera snabbare datorer, AI5, även ny hårdvara i form av ny kameror och glas ska till. Och ny rengöringsteknik för kamerorna. För att lösa problem som Lidar och radar redan löser.

En annan anledning till att Tesla tidigt skippade Lidar var teknikens prislapp. Tesla vill kunna sälja självkörande bilar till låga kostnader. Och Lidar som är tillräckligt bra för självkörning kommer inte att bli massproducerad i tillräckligt stor skala för att komma ner i pris, var teorin. Båda dessa anledningar håller på att försvinna idag. Priset på Lidar har sjunkit dramatiskt den senaste tiden. Dessutom har ännu billigare radar-systemen blivit allt bättre, MobilEyes Imaging Radar använder radiovågor som går rakt igenom dimma, damm och kraftigt regn, men ger nu nästan samma detaljrikedom som en laser (Lidar har svårare i dessa förhållanden, tidigare radarsystem hade ingen detaljrikedom som imaging radar däremot presterar). På en livesänd konferens på teknikmässan CES berättade Mobileye nyligen Imaging radar kan ersätta Lidar. På Volkswagens självkörande ID Buzz sitter fem Lidar. Fyra av dessa kan ersättas med Mobileyes Imaging Radar. Målet är att Lidar helt ersätts av tekniken, vilket ska göra att företaget har 100.000 självkörande bilar på gatorna till 2033.

Om flera av Teslas kritiker har rätt i att Nivå 4/5 inte kan nås med enbart kameror, sitter Tesla fast med cirka 1 miljon kunder som redan har betalat för FSD. Att i efterhand utrusta dessa bilar med Lidar och radar är i praktiken omöjligt – en logistisk mardröm och lär bli svindyrt, kablar ska dras, bilen byggas om. Men även om Tesla löser problemet med självkörning endast med kameror, så kommer det ändå att bli kostsamt att eftermontera all ny teknik som just nu är under utveckling. Kameror, ny dator, nya rengöringstekniker. Och en sak som vi nämnde i förbigående, den nya datorn som ska lösa allt, enligt Elon Musk, HW5 kommer att dra 800 Watt, till skillnad från HW4 som drar under 200 Watt. Det är inte bara att montera in en sådan dator i en befintlig bil, 12 volt-systemen som de har kan inte hantera den typen av effekt. Kablarna är underdimensionerade. Hela elsystemet måste bytas ut och ett nytt 48 voltssystem måste in. Att byta ut en bils 12-voltssystem till ett 48 voltssystem i efterhand, på en Tesla-verkstad, kommer bara det troligen att kosta betydligt mer än vad kunderna har betalat för sin FSD. Man kan också fråga sig om det inte hade varit billigare med Lidar och Radar än att utveckla nya glas och nya kameror som ska pressa AI5 att fejka fotonräkning.

Tesla kan ju också välja att betala tillbaka pengarna till kunder som inte kan få FSD trots att de betalat för det i förväg. Det skulle sänka kommande intäkter (Tesla kan inte bokföra betalda FSD-system som intäkt förrän de levererat det). Men det här är ändå småpengar i jämförelse med vad det skulle kosta företaget om de ändå tillslut hamnar i en återvändsgränd, där enda utvägen heter Lidar och/eller Radar. För hur starka datorer du än har är det omöjligt att processa data som inte finns. Regn, dimma, snö, motljus är svåra hinder för att bara ha kameror som ska samla in information. Att lägga till radar/Lidar skulle innebära att Tesla tvingas skrota åratal av mjukvaruutveckling. Att börja om med en sensorfusion-stack, ett område där konkurrenter som Waymo och Mobileye redan har ett försprång på ett decennium, är en finansiell utmaning som troligen skulle knäcka börskursen och skulle leda till många års försening.

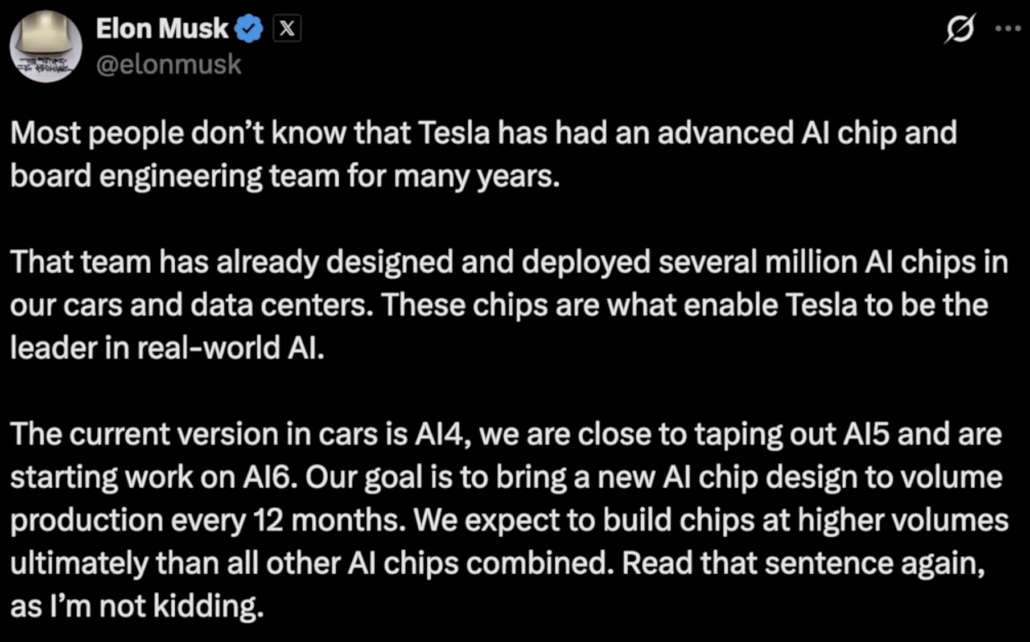

Men chipet då, teslas AI5, de har ju tagit fram det själv, det ska ju vara snabbare och bättre än Nvidias chip. Elon Musk säger dessutom att de ska producera fler chip än världens alla andra AI-chiptillverkare. Och det ska komma ett nytt chip varje år. De ska ju sälja hundratals miljoner robotar och lika många självkörande bilar. Och därmed bli störst på AI-chip.

Att ha egna chip ger ju konkurrenskraft gentemot alla andra som måste köpa dyra lösningar från Mobileye (som också utvecklar egna chip) eller Nvidia eller Qualcomm. Men inte heller här är Tesla längre längst fram. Kinesiska tillverkare som Nio och Xpeng rullar nu ut egen hårdvara för att runda Nvidia. Och innan Tesla börjar tillverka chip i hundratals miljoner exemplar kanske man ska ha funktionerna på plats, visa att det fungerar vattentätt och också kanske ha utvecklat robotar som någon vill köpa? Och frågan är om det verkligen är nödvändigt att utveckla egna monsterchip? Mobileys lösning med Image Radar och en Lidar får högkvalitativ data om avstånd direkt och behöver inte omvandla miljontals pixlar från en mängd kameror för att beräkna avstånd och processa omgivningen, vilket inte kräver lika avancerade chip, vilket i sin tur gör att Mobileys Nivå 4-system kommer att dra under 100 Watt. Vilket kan köras på ett 12-voltssystem. I slutändan kan det vara Tesla som har gjort sitt system mer komplicerat än det behöver vara. Till kommande system, som Mobileye kallar Mobileye Chauffeur har Mobileye tagit ner hårdvarukraven till 1 Lidar, 5 radar, 11 kameror och en enklare dator. Därmed har de lyckats få ner kostnaden för ett system med både radar och Lidar. När Tesla tvingas köpa dyr elektronik för att kompensera för bristen på sensorer, kan deras ”billiga” lösning i slutändan bli dyrare än konkurrenternas mer avancerade hårdvara.

Tesla kan helt enkelt ha kört rakt in i en återvändsgränd där nästa utlovade genombrott alltid tycks ligga precis runt hörnet, nej inte det hörnet, nästa hörn.

/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2026%2F04%2FElbilen-3-2026.jpg)

/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2026%2F04%2FPolestar-2-3-4-5.jpg)

/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2026%2F04%2FInterior-c-klass03.jpg)

/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2026%2F04%2FV2G_laddning_6.jpg)

/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2025%2F07%2FV2G_2025-1.jpg)

/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2026%2F03%2FMercedes-VLE03.jpg)

/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2026%2F04%2FSolid_state_Batteri_Greater-Bay-Technology.jpg)

/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2025%2F07%2FV2G_2025-1.jpg)

/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2026%2F04%2FV2G_laddning_6.jpg)

/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2026%2F04%2FDonut_Lab_5.jpg)

/https%3A%2F%2Felbilen.se%2Fwp-content%2Fuploads%2F2026%2F04%2FInterior-c-klass03.jpg)